За последние годы в мире мобильных телефонов произошли огромные изменения. Мы видим фундаментальные различия практически во всех аспектах, независимо от того, фокусируемся ли мы на размере или дизайне, производительности или других интеллектуальных функциях. Качество камер в настоящее время играет относительно важную роль. На данный момент можно сказать, что это один из важнейших аспектов смартфонов, в котором флагманы постоянно конкурируют. Кроме того, когда мы сравниваем, например, телефоны Android с iPhone от Apple, мы обнаруживаем ряд интересных отличий.

Возможно вас интересует

Если вы интересуетесь миром мобильных технологий, то наверняка знаете, что одно из самых больших отличий можно найти в разрешении сенсора. В то время как Android часто предлагает объектив с разрешением более 50 Мп, iPhone уже много лет делает ставку всего на 12 Мп и по-прежнему может предлагать фотографии более высокого качества. Однако системам фокусировки изображения уделяется мало внимания, и здесь мы сталкиваемся с довольно интересной разницей. Конкурирующие телефоны с операционной системой Android часто (частично) полагаются на так называемый лазерный автофокус, а смартфоны с логотипом надкушенного яблока этой технологией не обладают. Как это на самом деле работает, почему используется и на какие технологии опирается Apple?

Лазерный фокус против iPhone

Упомянутая технология лазерной фокусировки работает достаточно просто и ее использование имеет большой смысл. При этом в фотомодуле спрятан диод, излучающий излучение при нажатии на спусковой крючок. В этом случае излучается луч, который отражается от сфотографированного объекта/объекта и возвращается, и это время можно использовать для быстрого расчета расстояния с помощью программных алгоритмов. К сожалению, у этого есть и темная сторона. При съемке фотографий на больших расстояниях лазерная фокусировка становится менее точной, а также при съемке прозрачных объектов и неблагоприятных препятствий, которые не могут надежно отражать луч. По этой причине большинство телефонов по-прежнему используют проверенный временем алгоритм определения контрастности сцены. Датчик с таким может найти идеальное изображение. Комбинация работает очень хорошо и обеспечивает быструю и точную фокусировку изображения. Например, такая система (LDAF) есть в популярном Google Pixel 6.

С другой стороны, у нас есть iPhone, который работает немного по-другому. Но в основе это очень похоже. При нажатии триггера ключевую роль играет компонент ISP или Image Signal Processor, который был значительно усовершенствован за последние годы. Этот чип может использовать метод контрастности и сложные алгоритмы, чтобы мгновенно оценить лучший фокус и сделать качественную фотографию. Конечно, на основании полученных данных необходимо механически переместить объектив в нужное положение, но все камеры в мобильных телефонах работают одинаково. Хоть они и управляются «моторчиком», движение у них не вращательное, а линейное.

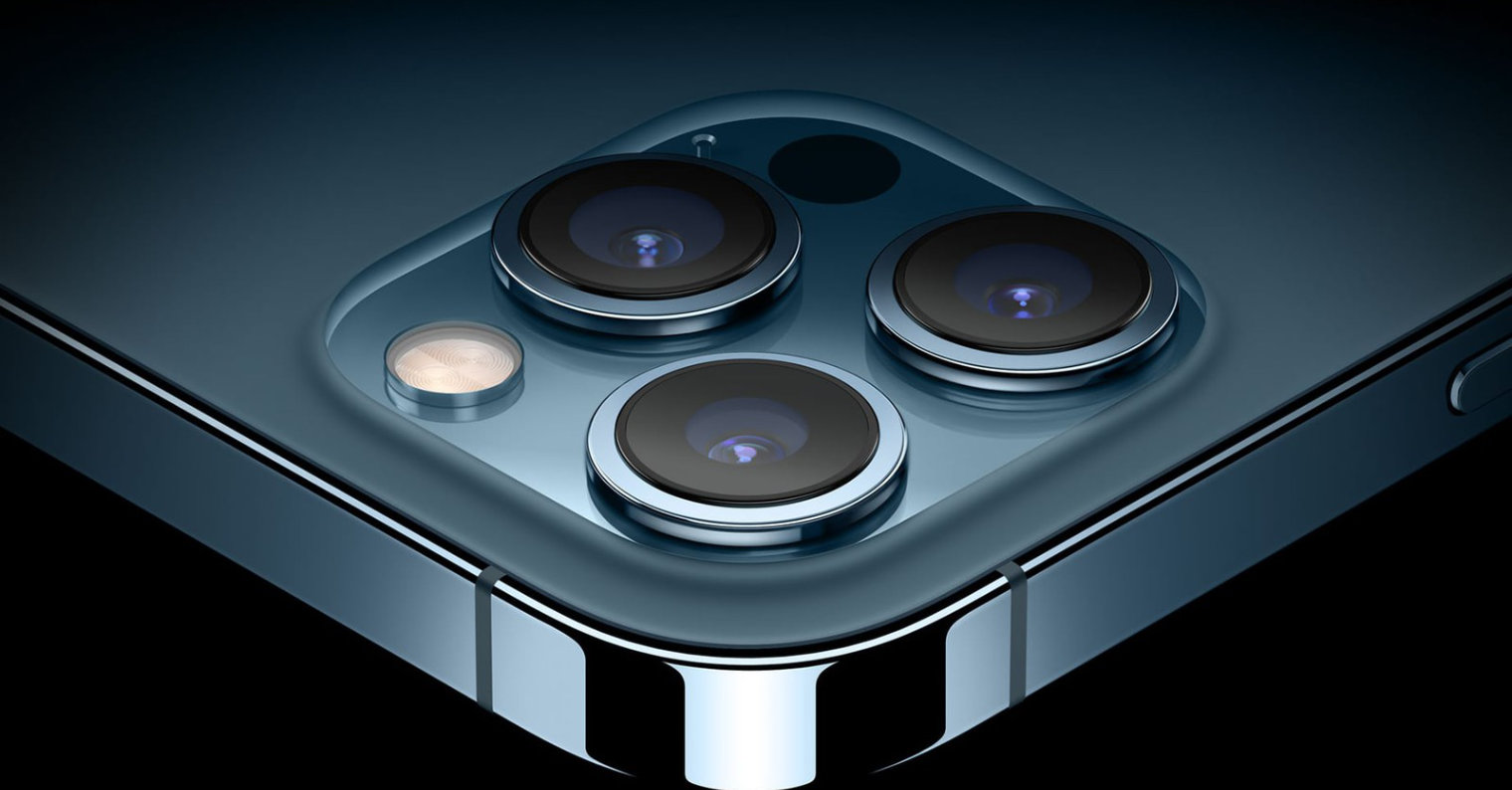

На шаг впереди — модели iPhone 12 Pro (Max) и iPhone 13 Pro (Max). Как вы уже догадались, эти модели оснащены так называемым сканером LiDAR, который может мгновенно определить расстояние до фотографируемого объекта и использовать эти знания в своих целях. По сути, эта технология близка к упомянутому лазерному фокусу. LiDAR может использовать лазерные лучи для создания 3D-модели окружающей среды, поэтому его в основном используют для сканирования помещений, в автономных транспортных средствах и для фотосъемки, в первую очередь портретов.

Возможно вас интересует

Адам Кос

Адам Кос

Путешествуйте по миру с Apple

Путешествуйте по миру с Apple